Foto: Wikimedia Commons

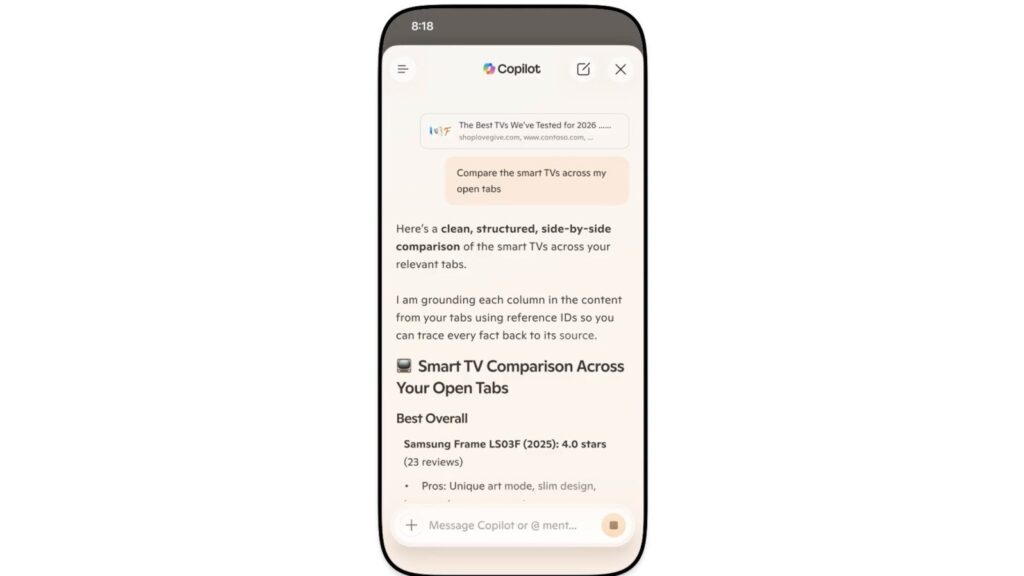

Microsoft je ponovno pod povećalom zbog načina na koji u svojim uvjetima korištenja opisuje Copilot, svoj AI alat koji je tvrtka posljednjih mjeseci snažno gurala prema poslovnim korisnicima. Na društvenim mrežama počela je kružiti odredba iz Copilotovih uvjeta korištenja, koji su, prema dostupnim informacijama, zadnji put ažurirani 24. listopada 2025. godine. U njima stoji kako je Copilot „za zabavu”, uz dodatno upozorenje da može griješiti, da možda neće raditi kako je zamišljeno te da se na njega ne treba oslanjati za važne savjete.

Drugim riječima, upozorenja o tome da se na izlazne rezultate modela ne treba bezrezervno oslanjati nisu rezervirana samo za skeptike umjetne inteligencije. Takve ograde, očito, dolaze i od samih kompanija koje AI proizvode. U slučaju Microsofta, to je posebno zanimljivo jer se tvrtka trenutačno fokusira na to da korporativni kupci plate za Copilot i uključe ga u svoje poslovne procese.

Na upit PCMagu, glasnogovornik Microsofta rekao je da će tvrtka ažurirati ono što je opisao kao „legacy language”, odnosno zastarjeli pravni i opisni jezik u dokumentima. „Kako se proizvod razvijao, taj jezik više ne odražava način na koji se Copilot danas koristi i bit će izmijenjen u našem sljedećem ažuriranju”, poručio je glasnogovornik. Time Microsoft zapravo priznaje da postojeći tekst više ne prati stvarnu upotrebu proizvoda.

Cijela je priča dodatno potaknula raspravu o tome kako tehnološke tvrtke same oblikuju očekivanja korisnika od generativne umjetne inteligencije. Iako se AI alati često predstavljaju kao moćni pomoćnici za posao, istraživanje i svakodnevne zadatke, njihovi vlastiti uvjeti korištenja redovito upozoravaju da rezultati nisu nepogrešivi. Tom’s Hardware ističe da Microsoft nije jedina tvrtka s takvom vrstom ograde u dokumentima.

Primjerice, i OpenAI i xAI korisnicima poručuju da se ne trebaju oslanjati na njihove odgovore kao na apsolutnu istinu. xAI upozorava da se njegovi rezultati ne smiju uzimati kao „the truth”, dok OpenAI navodi da njegov alat nije „sole service of truth or factual information”, odnosno jedini izvor istine ili činjeničnih informacija. Takve formulacije pokazuju da proizvođači AI modela istodobno potiču njihovu upotrebu, ali i pravno se ograđuju od prevelikog povjerenja u njihove odgovore.

Za Microsoft je to osjetljivo i zbog širih poslovnih ambicija oko Copilota. Ako tvrtka želi uvjeriti velike organizacije da plaćaju za alat i ugrade ga u radne tokove, onda zastarjela formulacija da je Copilot „za zabavu” može zvučati kao neugodan ostatak ranije faze razvoja proizvoda. Upravo zato najavljeno ažuriranje dolazi u trenutku kada AI proizvodi sve više ulaze u poslovnu upotrebu, a reputacija, pouzdanost i pravna jasnoća postaju jednako važni kao i same mogućnosti modela.