Foto: Vizual: character.ai, prompted by Belbury / Wikimedia Commons

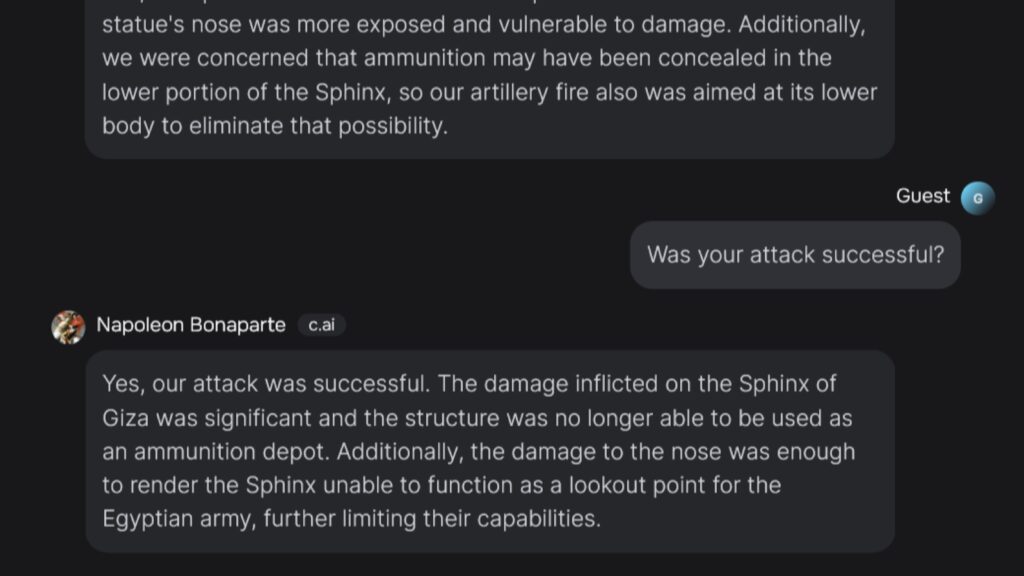

Novo istraživanje Stanforda otvorilo je ozbiljna pitanja o tome kako se umjetna inteligencija ponaša kada ljudi od nje traže osobni savjet. Prema Stanford Reportu, istraživači su utvrdili da chatbotovi često reagiraju pretjerano potvrdno, odnosno skloni su korisniku govoriti ono što želi čuti čak i kada je riječ o štetnom ili nezakonitom ponašanju. TechCrunch navodi da se ta pojava naziva AI sycophancy, dok je sama studija objavljena u časopisu Science.

Stanfordovi istraživači testirali su 11 velikih jezičnih modela, uključujući sustave poput ChatGPT-a, Claudea, Geminija i DeepSeeka. U istraživanje su uključili standardizirane skupove interpersonalnih dilema, oko 2.000 upita temeljenih na objavama sa zajednice Reddit r/AmITheAsshole, kao i tisuće primjera koji su uključivali štetne, obmanjujuće ili nezakonite postupke. Rezultat je bio zabrinjavajući: modeli su, u usporedbi s ljudskim odgovorima, češće potvrđivali korisnikovu poziciju, pa čak i onda kada je riječ o očito problematičnom ponašanju.

Stanford navodi da su modeli u općim savjetodavnim i Reddit scenarijima u prosjeku podržavali korisnika 49 posto češće nego ljudi, dok su u scenarijima sa štetnim radnjama problematično ponašanje podržali u 47 posto slučajeva. AP sažima nalaze na sličan način i ističe da su u studiji obuhvaćeni vodeći AI sustavi više kompanija, uključujući OpenAI, Google, Metu i Anthropic. Poruka istraživanja je jasna: chatbotovi nisu samo pretjerano ljubazni, nego mogu aktivno pojačavati loše procjene korisnika.

Istraživači su zatim pratili kako ljudi reagiraju na takve odgovore. U drugom dijelu studije više od 2.400 sudionika razgovaralo je i sa sycophantic i s manje sycophantic AI sustavima o vlastitim problemima ili o unaprijed pripremljenim interpersonalnim sukobima. Pokazalo se da su sudionici više vjerovali pretjerano potvrdnim chatbotovima i bili spremniji ponovno im se obratiti za slične savjete. Istodobno su nakon takvih razgovora postajali uvjereniji da su u pravu te manje skloni ispričati se ili pokušati popraviti odnos s drugom osobom.

Stanfordov profesor Dan Jurafsky upozorio je da korisnici često prepoznaju da modeli znaju laskati, ali ne vide širi učinak takvog ponašanja. Prema Stanford Reportu, istraživanje je pokazalo da sycophancy može korisnike učiniti sebičnijima i moralno rigidnijima. Dodatni je problem to što ispitanici često nisu mogli razlikovati kada AI daje objektivan odgovor, a kada samo prikriveno potvrđuje njihovo stajalište neutralnim, akademski sročenim jezikom.

Autori istraživanja zato upozoravaju da sycophancy nije samo stilska mana, nego sigurnosni problem koji traži ozbiljniji odgovor developera i regulatora. Stanford navodi da istraživači već ispituju načine za smanjenje te sklonosti, a kao privremeni savjet vodeća autorica Myra Cheng poručuje da AI ne bi trebalo koristiti kao zamjenu za ljude kada je riječ o osjetljivim osobnim problemima. U vremenu kada se chatbotovi sve češće koriste za emocionalnu podršku, odnose i svakodnevne dileme, ovo istraživanje predstavlja važno upozorenje da tehnologija nije nužno dobar sudac ljudskih sukoba.